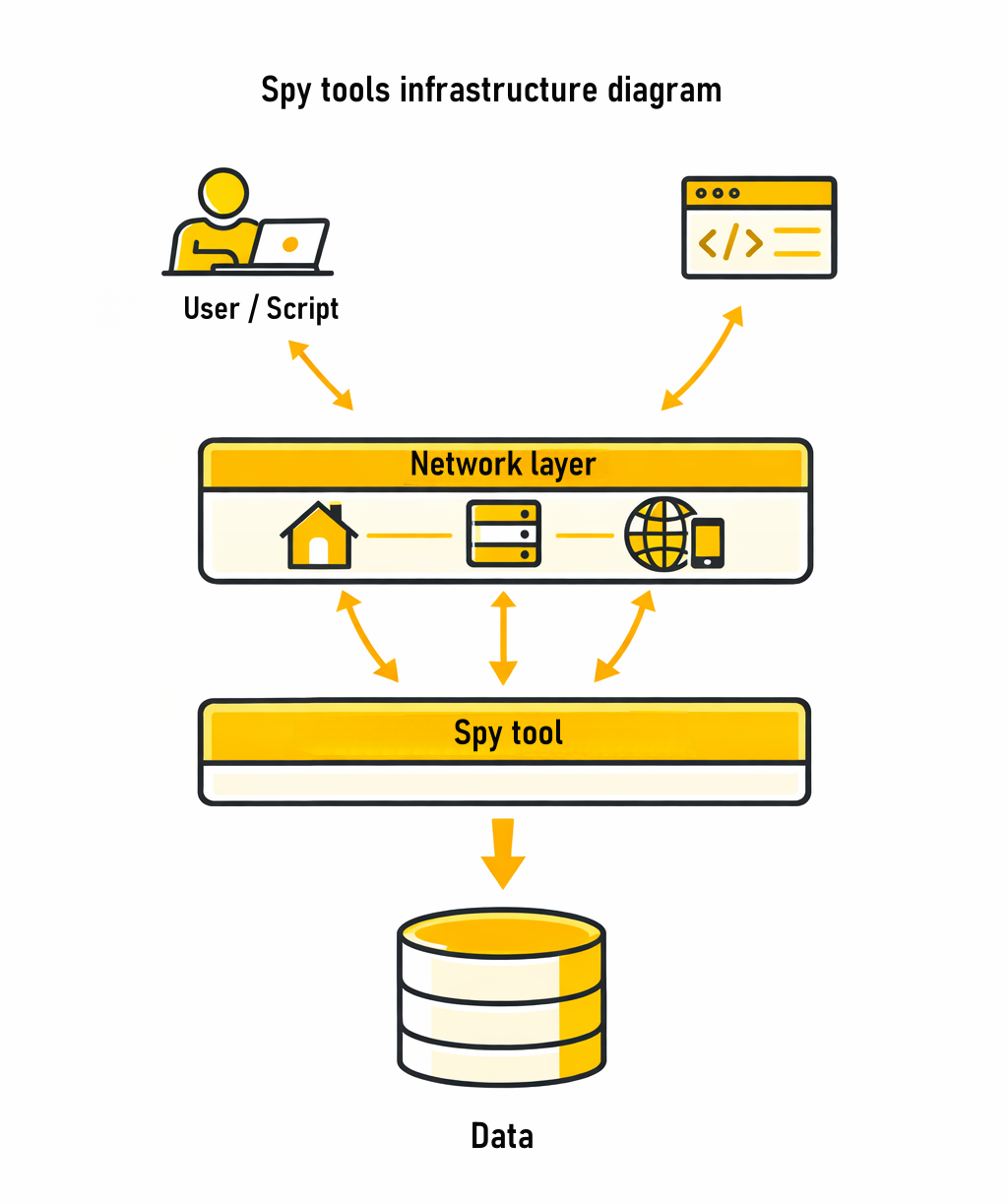

Die Arbeit mit Spy-Tools: Von einfachen Aktionen zu einer stabilen Infrastruktur

Die Arbeit mit Spy-Tools beginnt meist mit einfachen Schritten: der Suche nach Creatives, dem Filtern nach Geos und der Analyse von Werbekombinationen. In dieser Phase scheint es, dass das Tool die Aufgabe vollständig abdeckt – die Daten sind zugänglich, die Ergebnisse konsistent und die Leistung ausreichend.

Doch mit wachsendem Arbeitsaufwand ändert sich das Systemverhalten. Automatisierung wird eingeführt, die Anzahl der Anfragen steigt und mehrere Prozesse laufen parallel. Irgendwann wird bemerkbar, dass die Ergebnisse nicht mehr so konsistent sind: Einige Daten laden nicht, Antworten kommen verzögert und bestimmte Werbekombinationen verschwinden einfach.

Dies ist eine gängige Situation. In den meisten Fällen liegt das Problem nicht am Spy-Tool selbst, sondern daran, wie der Workflow drumherum strukturiert ist.

Warum Probleme bei der Ausweitung der Recherche auftreten

Wenn die Werberecherche systematischer wird, ändert sich die Art der Last. Anstelle isolierter Aktionen werden Dutzende oder sogar Hunderte von Anfragen generiert – insbesondere bei der Nutzung von API-Integrationen und Automatisierung.

In dieser Phase treten typischerweise mehrere Muster auf:

Verwendung identischer oder sich wiederholender IPs

Hohe Anfragefrequenz ohne Pausen

Mangel an angemessener Lastverteilung

Nutzung einer einzigen Konfiguration für alle Aufgaben

Jeder dieser Faktoren für sich mag unbedeutend erscheinen. Zusammen führen sie jedoch dazu, dass sich das System weniger konsistent verhält.

Wie das in der Praxis aussieht

In realen Workflows treten Probleme schrittweise auf.

Beispielsweise funktioniert bei der Analyse von Facebook Ads anfangs alles korrekt. Man kann zwischen Geos wechseln, Creatives untersuchen und Werbekombinationen identifizieren. Sobald man jedoch mehrere Tabs öffnet, Filter aktiv aktualisiert und parallel arbeitet, wird spürbar, dass einige Daten langsamer laden.

Noch deutlicher wird die Situation bei der Automatisierung. Zum Beispiel beim Sammeln von 200–300 Creatives:

Anfängliche Anfragen liefern genaue Daten.

Verzögerungen treten auf.

Einige Antworten sind unvollständig.

Bestimmte Anfragen erfordern erneute Versuche (Retries).

Ein ähnliches Muster zeigt sich bei TikTok Ads, insbesondere über mehrere Geos hinweg. Infolgedessen kann es so wirken, als seien weniger Daten verfügbar, während sich in Wirklichkeit die Qualität des Datenzugriffs verändert.

Wie ein stabiler Workflow aufgebaut wird

Stabilität kommt nicht von einem einzelnen Tool, sondern von der Struktur. In reiferen Setups ändert sich der Ansatz der Recherche selbst. Anstatt einer einzelnen Aktion wird sie in mehrere Phasen unterteilt – von der ersten Filterung und Analyse bis hin zur Datenerfassung, wiederholten Validierung und API-Workflows.

Jede dieser Phasen erzeugt eine unterschiedliche Art von Last, weshalb sie verschiedene Ansätze für Verbindungen und Anfrageverteilung erfordern. Diese Trennung ermöglicht es dem System, auch bei steigendem Volumen stabil zu bleiben.

Abstimmung von Proxy-Typen auf Aufgaben

Einer der Schlüsselfaktoren ist die Abstimmung der Proxy-Typen auf spezifische Anwendungsfälle.

In der Praxis basieren Workflows oft auf Kombinationen:

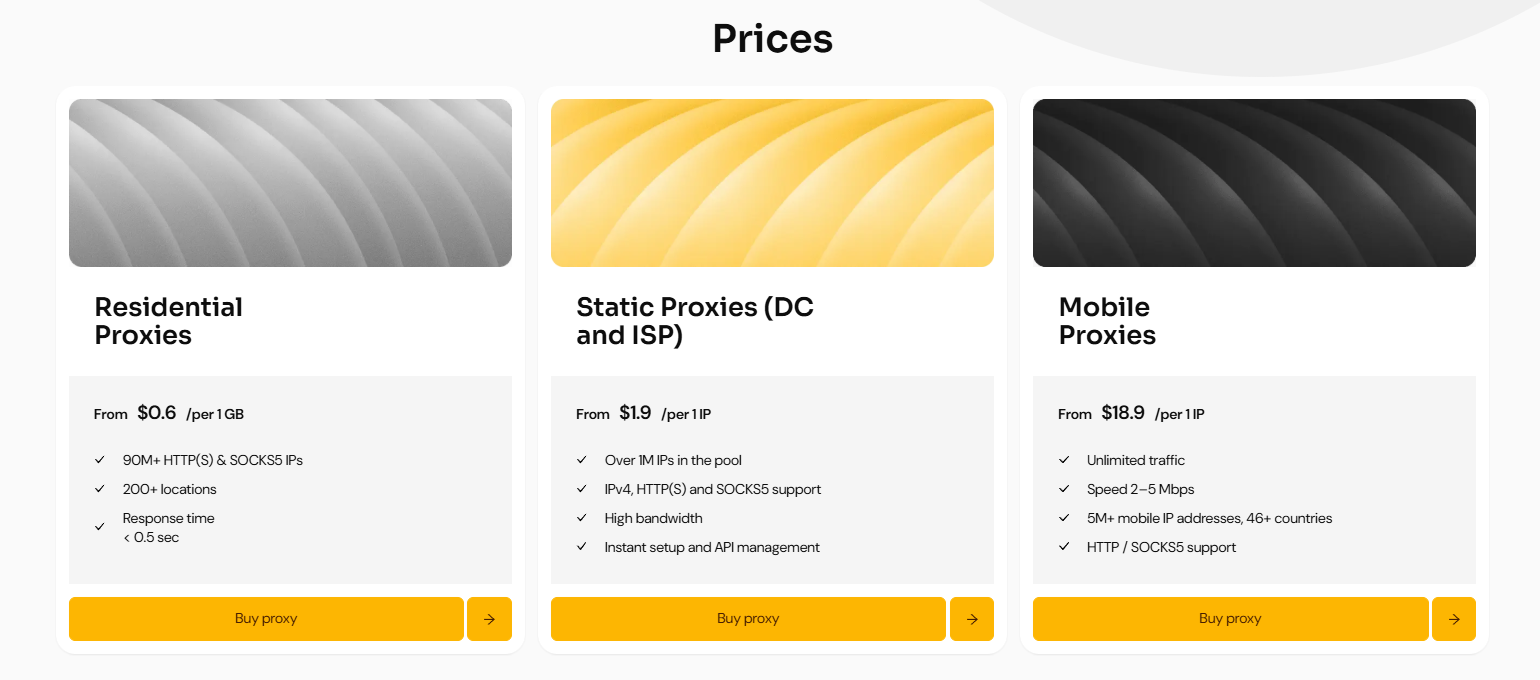

Residential Proxies – für breite Recherche und verteilte Datenerfassung.

ISP Proxies – für stabile Sitzungen und wiederholte Aktionen.

Datacenter Proxies – für API-Aufrufe und technische Anfragen.

Diese Trennung hilft, Lastkonflikte zu vermeiden und macht das Systemverhalten vorhersehbarer. Beispielsweise lassen sich diese Szenarien bei der Nutzung von MangoProxy innerhalb einer einzigen Infrastruktur verwalten, ohne Prozesse auf verschiedene Dienste aufteilen zu müssen.

Für Aufgaben im Zusammenhang mit API- und technischen Anfragen können statische Datacenter-Proxies verwendet werden – mit dem Promo-Code SPYHOUSE ist ein Rabatt von 15 % verfügbar.

Warum das bloße Erhöhen der Anfragen nicht funktioniert

Wenn Daten unzureichend werden, ist es natürlich, die Anzahl der Anfragen erhöhen zu wollen. Ohne eine Änderung der Logik führt dies jedoch meist zum Gegenteil. Die Last verteilt sich ungleichmäßig. Einige IPs werden überlastet, Traffic wird ineffizient genutzt, die Anzahl der wiederholten Anfragen steigt und die Gesamtstabilität des Systems sinkt.

Daher ist der entscheidende Faktor nicht das Volumen, sondern die Kontrolle. Es kommt darauf an, wie oft Anfragen gesendet werden, wie sie über IP-Adressen verteilt sind und wie die Rotationslogik strukturiert ist. Diese Parameter bestimmen letztlich, wie stabil das System bei der Skalierung bleibt.

Die Rolle der Geografie

Ein weiterer wichtiger Faktor ist die Geografie.

In Spy-Tools hängen Daten oft von der Region ab, was besonders bei TikTok und Push-Ads bemerkbar ist. Wenn alle Anfragen von einem einzigen Standort kommen, erscheinen einige Werbekombinationen möglicherweise nie in den Ergebnissen.

Mit fortschreitender Recherche wird dies kritisch. Deshalb beinhalten Workflows oft eine regionale Verteilung. Die Verwendung von Proxies mit globaler Abdeckung ermöglicht es:

Ergebnisse über verschiedene Länder hinweg zu vergleichen.

Lokale Werbemuster zu identifizieren.

Ein vollständigeres Bild der Daten zu erstellen.

Praktische Schlussfolgerungen

Die Ausweitung der Werberecherche bedeutet nicht, die Aktivität zu steigern, sondern den Ansatz zu ändern. Ein stabiles System basiert auf mehreren Kernprinzipien: Aufgaben werden getrennt, anstatt in einem Prozess kombiniert zu werden; Verbindungstypen werden auf spezifische Szenarien abgestimmt; die Last wird kontrolliert verteilt; und die Geografie wird berücksichtigt.

In diesem Kontext sind Proxies kein bloßes Hilfsmittel mehr, sondern Teil der Infrastruktur. Sie beeinflussen direkt, wie konsistent und vorhersehbar das System bei wachsender Arbeitslast arbeitet.

FAQ

Warum werden die Daten bei steigendem Anfragevolumen instabiler?

Weil sich die Art der Last ändert. Anfragen werden häufiger und repetitiver, und ohne ordnungsgemäße Verteilung beginnt das System, sie weniger gleichmäßig zu verarbeiten.

Kann ein einziger Proxy-Typ für alles verwendet werden?

Technisch ja, aber in der Praxis schränkt dies die Flexibilität ein. Verschiedene Aufgaben – wie manuelle Analyse, Parsing und API-Nutzung – erfordern unterschiedliches Verbindungsverhalten.

Warum laden einige Daten nicht?

Dies ist meist kein Problem des Tools selbst, sondern liegt an Überlastung oder schlechter Anfrageverteilung. Bei ungleichmäßiger Last verschlechtern sich einige Verbindungen, was die Vollständigkeit der Daten beeinträchtigt.

Ist die Geografie wichtig?

Ja. In Spy-Tools hängen die Ergebnisse oft von der Region ab. Das Arbeiten von einem einzigen Standort aus kann die Sichtbarkeit bestimmter Werbekombinationen einschränken.

Fazit

Mit zunehmender Arbeit mit Spy-Tools ändern sich sowohl das Datenvolumen als auch die Systemanforderungen. Stabilität ist keine Standardeigenschaft mehr – sie wird zum Ergebnis architektonischer Entscheidungen. Die Art und Weise, wie Aufgaben strukturiert, Lasten verwaltet und Traffic verteilt werden, definiert letztendlich, wie effektiv die Werberecherche langfristig sein wird.

DE

DE

EN

EN

UK

UK

RU

RU

AR

AR

BN

BN

ZH

ZH

ES

ES

FR

FR

HI

HI

ID

ID

UR

UR

PT

PT

TR

TR

Kommentare 0